2023年8月20日-23日,第十八届中国中文信息学会暑期学校暨《前沿技术讲习班》第三十七期和第三十八期在京举行。本届讲习班以“基座大模型的构建方法与训练技巧”和“大模型的领域应用与学术前沿”为主题,邀请了来自首批国内开源大模型企业和一线国内大模型研究学者,系统讲述大模型基础知识、构建方法、核心挑战和应用前景,为感兴趣的学者、学生和工程师提供系统学习和交流的机会,促进国内大模型的学术前沿发展和应用实践落地。中国科学院自动化研究所张家俊研究员、陈玉博副研究员、中国科学院计算技术研究所庞亮副研究员担任学术主席。

讲习班邀请了清华大学刘知远副教授、复旦大学邱锡鹏教授及团队、智谱华章张鹏博士及团队、中国科学院自动化研究所刘静研究员及团队、复旦大学魏忠钰副教授、中国科学院计算技术研究所冯洋研究员、中国人民大学赵鑫教授、微软亚洲研究院卢帅研究员、天津大学熊德意教授及团队、清华大学兰艳艳教授及团队和中国科学技术大学冯福利教授针对讲习班主题,作了系统深入地讲解。

开幕式上,讲习班学术主席、青工委主任张家俊研究员介绍了中国中文信息学会基本情况和前沿技术讲习班的定位、两个主题及预告了大模型系列讲座,并欢迎学员们来京参会。讲习班由学术主席陈玉博副研究员主持。

学会青工委主任、中国科学院自动化研究所张家俊研究员致开幕辞

8月20日上午,清华大学刘知远副教授作题为《迈向通用的人工智能》的报告,重点介绍了大模型与过去深度学习模型相比,在模型框架、微调适配以及推理计算等方面的重要特性,并探讨大模型未来的研发应用范式。

清华大学刘知远副教授作题为《迈向通用的人工智能》的报告

下午,复旦大学邱锡鹏教授和上海人工智能实验室颜航博士作题为《大型语言模型的科学挑战和技术实现》的报告,介绍了大型语言模型的科学挑战和技术路径、关键技术以及开源平台,主要内容包括大型语言模型的技术原理和科学挑战、大型语言模型的预训练经验和微调经验和介绍大模型的开源平台OpenLMLab等内容。

复旦大学邱锡鹏教授作题为《大型语言模型的科学挑战和技术实现》的报告

上海人工智能实验室颜航博士作题为《大型语言模型的科学挑战和技术实现》的报告

8月21日上午,智谱华章张鹏博士和柴思远博士作题为《ChatGLM:认知大模型及应用初探》的报告,介绍了智谱AI研发的预训练框架研发的开源双语模型GLM-130B,以及基于GLM-130B打造的千亿基座的中英文对话模型 ChatGLM (chatglm.cn)和全球下载量超过400万的开源模型ChatGLM-6B,并介绍了ChatGLM在行业应用上的一些探索。

智谱华章张鹏博士作题为《ChatGLM:认知大模型及应用初探》的报告

智谱华章柴思远博士作题为《ChatGLM:认知大模型及应用初探》的报告

下午,中国科学院自动化研究所刘静研究员和郭龙腾副研究员作题为《多模态预训练模型的构建与应用》的报告,主要分析了多模态预训练模型的重要性与必要性,回顾当前多模态预训练模型的研究进展,并介绍多模态大模型的架构设计、学习优化与下游应用,最后还阐述了多模态预训练模型主要应用场景与未来展望。

中国科学院自动化研究所刘静研究员作题为《多模态预训练模型的构建与应用》的报告

中国科学院自动化研究所郭龙腾副研究员作题为《多模态预训练模型的构建与应用》的报告

8月22日上午,复旦大学魏忠钰副教授作题为《大语言模型驱动的自主智能体》的报告,从大语言模型的自我反省和提升,多语言模型的交互和动态自然语言处理任务设定,以及大语言模型驱动的多智能体应用等三个方面综述大模型驱动的自主智能体研究。中国科学院计算技术研究所冯洋研究员作题为《大语言模型及应用》的报告,介绍了主流大语言模型的原理以及下游适应方式,并讲解大语言模型的两个应用示例-chatGPT及百聆大模型的主要技术,预测了大模型的未来发展趋势。

复旦大学魏忠钰副教授作题为《大语言模型驱动的自主智能体》的报告

中国科学院计算技术研究所冯洋研究员作题为《大语言模型及应用》的报告

下午,中国人民大学赵鑫教授作题为《大语言模型的幻象问题》的报告,围绕大语言模型的幻象问题展开,探讨了幻象问题的产生原因及相关解决途径,并介绍大语言模型的评测方法。微软亚洲研究院卢帅研究员作题为《大模型时代下的代码智能技术》的报告,介绍了团队在代码预训练模型上的探索成果,以及大模型时代AI辅助软件开发的机遇与挑战。

中国人民大学赵鑫教授作题为《大语言模型的幻象问题》的报告

微软亚洲研究院卢帅研究员作题为《大模型时代下的代码智能技术》的报告

8月23日上午,天津大学熊德意教授和沈田浩博士作题为《大语言模型对齐》的报告,首先概述了对齐的基本概念和必要性,简述其存在的社会和技术挑战,分析大语言模型对齐的主要技术路线和方法,探讨如何对大语言模型对齐进行评测,并对未来趋势进行展望。同时,综述了目前大语言模型外部对齐的具体方法,包括人类反馈强化学习及其变种,AI辅助对齐等。

天津大学熊德意教授作题为《大语言模型对齐》的报告

天津大学沈田浩博士作题为《大语言模型对齐》的报告

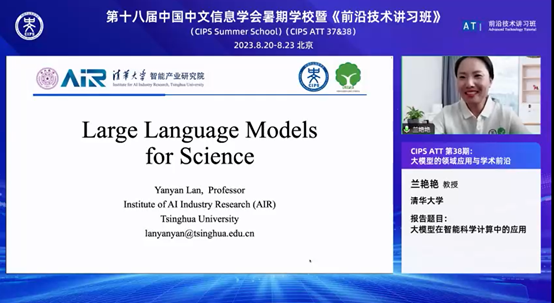

下午,清华大学兰艳艳教授、洪鑫博士和冯世坤博士作题为《大模型在智能科学计算中的应用》的报告,介绍了大规模预训练语言模型在这些科学领域的应用,并聚焦于药物研发相关问题阐述最新的大模型进展,总结科学问题和挑战。中国科学技术大学冯福利教授作题为《大模型推荐技术及展望》的报告,介绍了大模型推荐技术的进展,包括如何教会LLM做推荐及如何利用LLM推动推荐范式革新,还进一步讨论了大模型推荐带来的机遇与挑战。

清华大学兰艳艳教授在线作题为《大模型在智能科学计算中的应用》的报告

清华大学洪鑫博士和冯世坤博士作题为《LLMs for Science》的报告

中国科学技术大学冯福利教授作题为《大模型推荐技术及展望》的报告

闭幕式上,中国科学院自动化研究所陈玉博副研究员对本次讲习班的课程内容进行了总结,并欢迎学员们继续关注和参与学会举办的学术活动。本次讲习班吸引了300余名学生和学者参与,期间学员们系统地了解了大模型的构建方法与应用前景,并与一线国内大模型研究学者进行交流,促进了国内大模型的学术前沿发展和应用实践落地。

中国科学院自动化研究所陈玉博副研究员致闭幕辞

会场内景